Unity kündigt Safe Voice an

Mit einem neuen Tool will Unity Spielestudios im Kampf gegen Toxizität in ihren Games unterstützen. Das KI-gestützte Tool zieht dabei auch Faktoren wie Tonalität, Lautstärke und Emotionalität, um toxisches Verhalten zu erkennen.

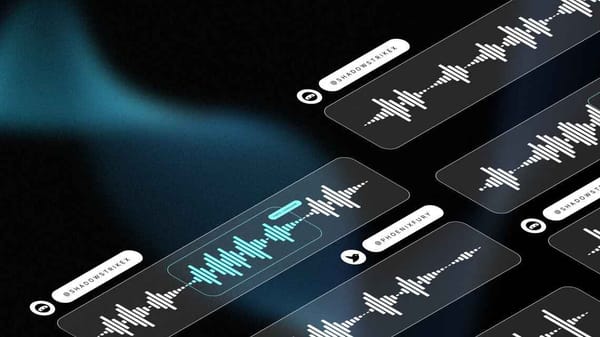

Der Middleware-Hersteller Unity will Spielestudios, die in ihren Titel den Unity Voice Chat (Vivox) nutzen, mit einem neuen Tool im Kampf gegen toxisches Verhalten in der Community unterstützen. Gelingen soll dies über das neue Tool "Unity Safe Voice", welches das Unternehmen jetzt ankündigte.

Laut Unity nutzen basieren viele andere automatisierte Lösungen gegen toxisches Verhalten in Chats Speach-to-Text und andere transskriptionsbasierte Analysen. Hier gehe Safe Voice einen Schritt weiter und zieht weitere Faktoren hinzu, um Missinterpretationen zu vermeiden. Safe Voice zieht beispielsweise Charakteristika wie Tonalität, Lautstärke, Tonhöhe oder auch Emotionalität in Betracht. Durch diese Kontext-basierte Analyse könnten in Verbindung mit KI-gestützten Methoden wie Obszönitäten, Drohungen, Beleidigungen, Identitätsangriffe, problematische Sprache oder verbale Angriffe.

Über "Safe Voice" kann dann die Reaktion auf solche Vorfälle organisiert und priorisiert werden. Ziel sei es, vorher kosten- und zeitintensive manuelle Maßnahmen, die nur verzögert ergriffen werden können, zu automatisieren. Laut Unity ist es sogar möglich, proaktiv Verhalten zu beobachten, das auf eine mögliche toxische Begegnung schließen lässt, wie aktiven Muten oder vorzeitiges Verlassen von Spielesitzungen.